Mar 18

/

David Gall

Digital Omnibus: Was die verschobenen Hochrisiko-Fristen im AI Act für Unternehmen bedeuten

Key Takeaways

- Der EU-Rat hat am 13. März 2026 seine Verhandlungsposition zum Digital Omnibus beschlossen. Die Frist für eigenständige Hochrisiko-KI-Systeme verschiebt sich von August 2026 auf voraussichtlich Dezember 2027.

- Für in Produkte eingebettete Hochrisiko-KI-Systeme gilt die neue Frist August 2028.

- Die Transparenzpflichten nach Artikel 50 (Kennzeichnung KI-generierter Inhalte) bleiben zum 2. August 2026 bestehen – hier ändert der Digital Omnibus nichts.

- Solange der Digital Omnibus nicht final verabschiedet ist, gilt rechtlich weiterhin die ursprüngliche Frist August 2026 für Hochrisiko-KI.

- Unternehmen, die jetzt pausieren, riskieren eine Compliance-Lücke, fehlende Strukturen und höhere Kosten bei nachträglicher Umsetzung.

- Die gewonnene Zeit ist eine Chance, KI-Governance und Risikomanagement systematisch aufzubauen – nicht ein Signal zum Abwarten.

Inhaltsverzeichnis

- Kurze Antwort: Was ändert der Digital Omnibus?

- Was ist der Digital Omnibus – und warum kommt er jetzt?

- Die neuen Fristen im Detail: Was verschiebt sich, was bleibt?

- Praxisbeispiele: Was bedeutet das für verschiedene Unternehmen?

- Typische Fehler – und wie Sie sie vermeiden

- Entscheidungsbaum: Müssen Sie jetzt handeln oder können Sie warten?

- 3 Schritte, wie Unternehmen sofort reagieren sollten

- FAQ

- Weiterführende Artikel

Kurze Antwort: Was ändert der Digital Omnibus?

Der Digital Omnibus ist ein Gesetzesvorschlag der EU-Kommission vom 19. November 2025, der unter anderem die Umsetzungsfristen für Hochrisiko-KI-Systeme im AI Act anpassen soll. Der EU-Rat hat am 13. März 2026 seine Verhandlungsposition dazu festgelegt. Im Kern: Die Pflichten für eigenständige Hochrisiko-KI-Systeme (Annex III) sollen nicht mehr am 2. August 2026 greifen, sondern erst am 2. Dezember 2027. Für in Produkte eingebettete Hochrisiko-KI gilt der 2. August 2028 als neuer Stichtag.

Aber Achtung: Solange der Digital Omnibus nicht durch das Europäische Parlament und den Rat final beschlossen und in Kraft getreten ist, bleibt die bestehende Frist vom 2. August 2026 rechtlich gültig.

Und: Die Transparenzpflichten nach Artikel 50 – also Kennzeichnung von Deepfakes und KI-generierten Texten – sind von der Verschiebung nicht betroffen. Sie gelten weiterhin ab August 2026.

Und: Die Transparenzpflichten nach Artikel 50 – also Kennzeichnung von Deepfakes und KI-generierten Texten – sind von der Verschiebung nicht betroffen. Sie gelten weiterhin ab August 2026.

Was ist der Digital Omnibus – und warum kommt er jetzt?

Der Hintergrund

Seit dem Inkrafttreten des EU AI Act am 1. August 2024 wurde zunehmend deutlich, dass die Umsetzung für viele Unternehmen schwieriger ist als erwartet. Mehrere Faktoren haben dazu beigetragen:

Die Veröffentlichung harmonisierter Standards durch die europäischen Normungsorganisationen hat sich verzögert. Die Europäische Kommission hat ihre eigene Frist versäumt, bis Februar 2026 verbindliche Leitlinien zur Hochrisiko-Klassifizierung zu veröffentlichen. Und zahlreiche EU-Mitgliedstaaten liegen bei der nationalen Umsetzung des AI Act hinter dem Zeitplan.

Gleichzeitig fordern Industrieverbände seit Monaten, die Regulierungslast zu reduzieren. 48 europäische Branchenverbände haben in einem offenen Brief an das Europäische Parlament und den Rat gewarnt, dass viele Unternehmen – insbesondere aus regulierten Sektoren wie Gesundheitswesen, Fertigung und Energie – unter einer doppelten oder sogar dreifachen Regulierungsschicht leiden.

Was der EU AI Act grundsätzlich für Unternehmen bedeutet, können Sie in unserem Fachartikel nachlesen.

Was der EU AI Act grundsätzlich für Unternehmen bedeutet, können Sie in unserem Fachartikel nachlesen.

Was enthält der Vorschlag?

Der Digital Omnibus umfasst mehrere Anpassungen am AI Act:

Verschobene Anwendungsfristen für Hochrisiko-KI: Die Anwendung der Hochrisiko-Vorschriften wird an die Verfügbarkeit harmonisierter Standards und Compliance-Instrumente gekoppelt. Der Rat hat feste Enddaten vorgeschlagen: 2. Dezember 2027 für eigenständige Systeme, 2. August 2028 für in Produkte eingebettete Systeme.

Erweiterte Grandfathering-Klausel: Hochrisiko-KI-Systeme, die bereits auf dem Markt sind, sollen von den neuen Anforderungen befreit sein, bis sie wesentliche Designänderungen erfahren. Die bisherige Stichtagsregelung (2. August 2026) entfällt.

Zentralisierte Durchsetzung durch das AI Office: Das EU-AI-Office soll stärkere Befugnisse erhalten, insbesondere bei der Überwachung von KI-Systemen in sehr großen Online-Plattformen.

Erleichterungen für KMU und Small Mid-Caps: Bestimmte regulatorische Ausnahmen, die bisher nur für KMU galten, sollen auf kleine Midcap-Unternehmen ausgeweitet werden.

Neues Verbot: Der Rat hat ein Verbot von KI-Systemen hinzugefügt, die nicht-einvernehmliche sexualisierte Deepfakes oder Darstellungen von Kindesmissbrauch erzeugen.

Wo steht das Verfahren aktuell?

Am 13. März 2026 hat der Rat der EU seine Verhandlungsposition angenommen. Das Europäische Parlament stimmt am 18. März 2026 in den zuständigen Ausschüssen (LIBE und IMCO) über seinen Bericht ab. Danach beginnen die Trilog-Verhandlungen zwischen Parlament, Rat und Kommission – voraussichtlich im April oder Mai 2026. Wie lange diese dauern, ist offen.

Warum ist das wichtig? Solange der Digital Omnibus nicht verabschiedet ist, gibt es keine Rechtsgrundlage für eine Verschiebung. Unternehmen, die ihre Compliance-Projekte auf Basis einer erwarteten Fristverlängerung pausieren, handeln ohne gesetzliche Absicherung. Wer jetzt untätig bleibt, riskiert, bei einem Scheitern oder einer Verzögerung des Omnibus-Verfahrens am 2. August 2026 nicht compliant zu sein.

Was als Nächstes? Verfolgen Sie die Trilog-Verhandlungen aktiv. Ein klares Verständnis der KI-Risikoklassen und des Anwendungsbereichs ist die Grundlage, um die Auswirkungen des Omnibus auf Ihr Unternehmen einzuschätzen.

Warum ist das wichtig? Solange der Digital Omnibus nicht verabschiedet ist, gibt es keine Rechtsgrundlage für eine Verschiebung. Unternehmen, die ihre Compliance-Projekte auf Basis einer erwarteten Fristverlängerung pausieren, handeln ohne gesetzliche Absicherung. Wer jetzt untätig bleibt, riskiert, bei einem Scheitern oder einer Verzögerung des Omnibus-Verfahrens am 2. August 2026 nicht compliant zu sein.

Was als Nächstes? Verfolgen Sie die Trilog-Verhandlungen aktiv. Ein klares Verständnis der KI-Risikoklassen und des Anwendungsbereichs ist die Grundlage, um die Auswirkungen des Omnibus auf Ihr Unternehmen einzuschätzen.

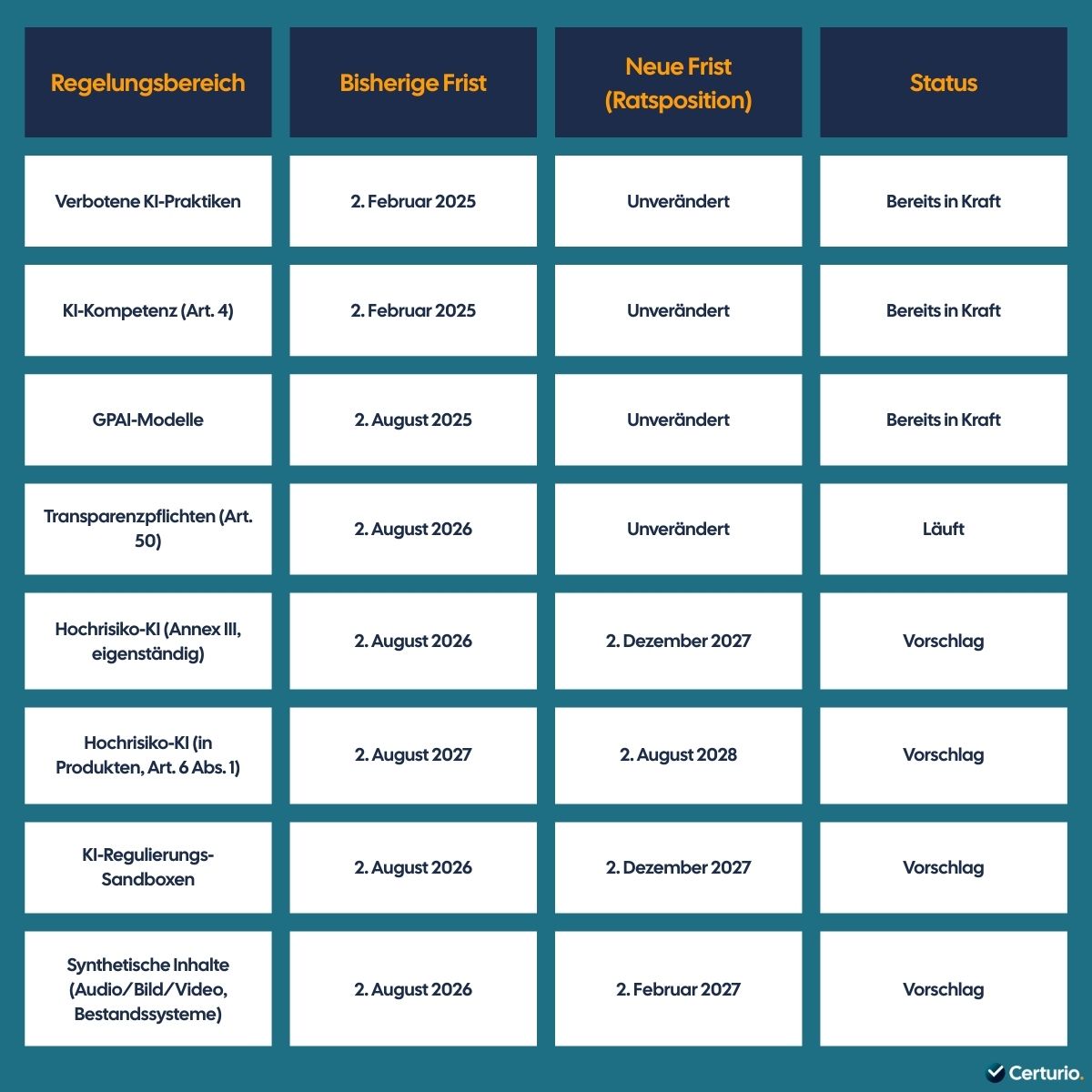

Die neuen Fristen im Detail: Was verschiebt sich, was bleibt?

Übersicht der Fristen

Checkliste: Was gilt bereits – und was nicht?

Bereits gültig und durchsetzbar:

- Verbot von Social Scoring, manipulativer KI und biometrischer Echtzeit-Identifikation (seit Februar 2025)

- Pflicht zur Sicherstellung von KI-Kompetenz im Unternehmen nach Artikel 4 (seit Februar 2025)

- Pflichten für Anbieter von General Purpose AI Modellen (seit August 2025)

Ab August 2026 gültig (auch mit Omnibus):

- Transparenzpflichten nach Artikel 50: Kennzeichnung von Deepfakes, KI-generierten Texten von öffentlichem Interesse, Chatbot-Hinweispflicht

- Pflichten für Emotionserkennungs- und biometrische Kategorisierungssysteme

Voraussichtlich verschoben (wenn Omnibus verabschiedet wird):

- Vollständige Anforderungen an Hochrisiko-KI-Systeme: Qualitätsmanagementsystem, Risikomanagement, technische Dokumentation, Konformitätsbewertung, EU-Datenbankregistrierung

- Einrichtung nationaler KI-Regulierungs-Sandboxen

Do's & Don'ts für Unternehmen

Do:

- KI-Inventar jetzt erstellen – unabhängig vom Omnibus

- Artikel-50-Transparenzpflichten bis August 2026 umsetzen

- KI-Kompetenz-Anforderungen prüfen und dokumentieren

- Risikobewertung für KI-Systeme beginnen

- Verantwortlichkeiten und Governance-Strukturen festlegen

Don't:

- Compliance-Projekte auf Basis einer erwarteten Fristverlängerung stoppen

- Annehmen, dass alle Pflichten verschoben werden (Artikel 50 bleibt)

- Auf finale harmonisierte Normen warten, bevor interne Prozesse aufgebaut werden

- Die KI-Kompetenz-Pflicht nach Artikel 4 ignorieren – sie gilt bereits

Warum ist das wichtig? Die differenzierte Betrachtung der Fristen ist entscheidend, weil viele Unternehmen fälschlicherweise annehmen, der gesamte AI Act werde verschoben. Tatsächlich bleiben die Transparenzpflichten und die KI-Kompetenz-Anforderungen vollständig bestehen. Wer hier nicht unterscheidet, läuft in eine Compliance-Lücke.

Was als Nächstes? Erstellen Sie ein vollständiges KI-Register und eine Inventarisierung aller in Ihrem Unternehmen eingesetzten KI-Systeme. Ohne diesen Überblick lässt sich keine belastbare Compliance-Strategie aufbauen.

Praxisbeispiele: Was bedeutet das für verschiedene Unternehmen?

Beispiel 1: Mittelständisches Maschinenbauunternehmen

Ein Maschinenbauer mit 800 Mitarbeitenden setzt KI-basierte Qualitätssicherung in der Produktion ein. Das System analysiert Kamerabilder und erkennt fehlerhafte Bauteile automatisch. Zusätzlich nutzt das Unternehmen einen KI-gestützten Chatbot für den Kundenservice.

Einordnung: Die KI-gestützte Qualitätssicherung fällt potenziell unter Annex III als sicherheitsrelevante Komponente. Hier greift die voraussichtliche Fristverlängerung bis Dezember 2027. Der Chatbot hingegen unterliegt den Transparenzpflichten nach Artikel 50 – und diese gelten ab August 2026 ohne Änderung. Das Unternehmen muss also bis August 2026 sicherstellen, dass Kunden erkennen können, dass sie mit einem KI-System interagieren. Gleichzeitig sollte es die gewonnene Zeit für die Hochrisiko-Anforderungen nutzen, um ein KI-Risikomanagement aufzubauen und die technische Dokumentation vorzubereiten.

Beispiel 2: Personaldienstleister mit KI-gestütztem Recruiting

Ein Personaldienstleister nutzt ein KI-System zur Vorauswahl von Bewerbungen. Das System analysiert Lebensläufe, bewertet Qualifikationen und erstellt ein Ranking der Kandidaten.

Einordnung: KI-Systeme im Bereich Beschäftigung und Personalmanagement sind explizit als Hochrisiko klassifiziert (Annex III, Abschnitt 4). Die Verschiebung auf Dezember 2027 verschafft dem Unternehmen mehr Zeit für die vollständige Compliance – Risikomanagement, Bias-Erkennung, technische Dokumentation, Human Oversight. Aber: Bereits jetzt gelten arbeitsrechtliche Anforderungen und DSGVO-Verpflichtungen bei automatisierter Entscheidungsfindung. Die Pflicht zur KI-Kompetenz nach Artikel 4 gilt ebenfalls bereits. Das Unternehmen sollte die Zeit nutzen, um den Betriebsrat einzubinden und KI-Richtlinien zu etablieren.

Beispiel 3: Finanzdienstleister mit KI-basiertem Kredit-Scoring

Eine Bank setzt ein KI-System ein, das die Kreditwürdigkeit von Antragstellern bewertet. Das System fließt direkt in die Kreditentscheidung ein.

Einordnung: KI für Kreditwürdigkeitsbewertung ist unter Annex III als Hochrisiko eingestuft. Die voraussichtliche Frist verschiebt sich auf Dezember 2027. Allerdings unterliegt die Bank bereits sektoraler Regulierung (z. B. MaRisk, EBA-Leitlinien). Der Digital Omnibus sieht vor, dass Unternehmen, die bereits unter sektoralen Compliance-Rahmenwerken arbeiten, von Doppelregulierung entlastet werden sollen. Trotzdem bleibt die AI-Act-spezifische Konformitätsbewertung erforderlich. Ein strukturierter Ansatz über ein KI-Managementsystem nach ISO 42001 hilft, sowohl sektorale als auch AI-Act-Anforderungen effizient zu integrieren.

Warum ist das wichtig? Die Beispiele zeigen: Die Auswirkungen des Digital Omnibus sind nicht einheitlich. Je nach eingesetztem KI-System, Risikoklasse und Branche unterscheiden sich die Pflichten erheblich. Eine pauschale Annahme – „alles ist verschoben" – führt zu Fehleinschätzungen. Unternehmen müssen systemgenau analysieren, welche Fristen für sie gelten.

Was als Nächstes? Klassifizieren Sie jedes KI-System einzeln nach seiner Risikoklasse. Eine Übersicht der AI Act Risikoklassen hilft bei der Einordnung.

Typische Fehler – und wie Sie sie vermeiden

Fehler 1: „Der ganze AI Act ist verschoben"

Das ist falsch. Nur die Hochrisiko-Pflichten werden voraussichtlich zeitlich gestreckt. Die Transparenzpflichten nach Artikel 50, die KI-Kompetenz-Anforderungen nach Artikel 4 und die GPAI-Pflichten bleiben unverändert. Unternehmen, die generative KI-Tools einsetzen, müssen sich bis August 2026 auf die Kennzeichnungspflichten vorbereiten.

Fehler 2: Compliance-Projekte stoppen und auf finale Normen warten

Harmonisierte Normen liefern technische Konkretisierung, aber die gesetzlichen Anforderungen stehen bereits fest. Ein Qualitätsmanagementsystem, Risikomanagement, technische Dokumentation und Human Oversight lassen sich auch ohne finale Normen aufbauen. Wer erst beginnt, wenn die Normen vorliegen, hat zu wenig Vorlauf.

Fehler 3: Keine Unterscheidung zwischen Anbieter- und Betreiberrolle

Der AI Act unterscheidet klar zwischen Anbietern (die KI-Systeme entwickeln oder auf den Markt bringen) und Betreibern (die KI-Systeme einsetzen). Beide haben Pflichten, aber unterschiedliche. Viele Unternehmen sind für verschiedene Systeme beides. Ohne diese Rollenklärung ist eine saubere Compliance-Zuordnung unmöglich.

Fehler 4: DSGVO und AI Act getrennt behandeln

Der AI Act ergänzt die DSGVO, ersetzt sie aber nicht. Gerade bei Hochrisiko-KI-Systemen überschneiden sich die Anforderungen an Datenschutz-Folgenabschätzung, Bias-Erkennung und automatisierte Entscheidungsfindung. Wer beide Regelwerke isoliert betrachtet, dupliziert Aufwand und übersieht Synergien. Ein integrierter Ansatz über die Schnittstellen zwischen AI Act und DSGVO spart Ressourcen.

Fehler 5: Artikel 4 KI-Kompetenz unterschätzen

Die Pflicht zur Förderung von KI-Kompetenz gilt seit Februar 2025. Sie betrifft alle Unternehmen, die KI-Systeme einsetzen – unabhängig von der Risikoklasse. Viele Unternehmen haben diese Verpflichtung bisher nicht adressiert. Bei Kontrollen durch die zuständige Aufsichtsbehörde fehlt dann der Nachweis.

Warum ist das wichtig? Jeder dieser Fehler kann zu konkreten Rechtsfolgen führen: Bußgelder bis zu 15 Millionen Euro oder 3 % des weltweiten Jahresumsatzes, Marktausschluss für nicht-konforme KI-Systeme oder Reputationsschäden durch öffentliche Aufsichtsverfahren. Fehleinschätzungen bei der Fristenberechnung sind dabei das häufigste Risiko.

Was als Nächstes? Führen Sie eine Gap-Analyse durch: Welche AI-Act-Pflichten gelten für Ihr Unternehmen bereits heute, welche ab August 2026, welche voraussichtlich erst 2027/2028? Die EU AI Act Schulung von Certurio enthält Checklisten und Blueprints, die genau diese Differenzierung unterstützen.

Entscheidungsbaum: Müssen Sie jetzt handeln oder können Sie warten?

Die Antwort hängt von drei Faktoren ab: Welche KI-Systeme setzen Sie ein? In welcher Rolle (Anbieter oder Betreiber)? Und welche Pflichten gelten bereits?

Frage 1: Setzen Sie KI-Systeme ein, die direkt mit Personen interagieren (z. B. Chatbots)? → Ja: Artikel-50-Transparenzpflichten greifen am 2. August 2026. Handeln Sie jetzt.

Frage 2: Setzen Sie generative KI ein, die Texte, Bilder, Audio oder Video erzeugt? → Ja: Kennzeichnungspflichten nach Artikel 50 greifen am 2. August 2026. Der zweite Entwurf des Code of Practice liegt seit 3. März 2026 vor. Prüfen Sie die Anforderungen jetzt.

Frage 3: Betreiben oder entwickeln Sie KI-Systeme, die unter Annex III als Hochrisiko fallen (z. B. Recruiting, Kredit-Scoring, kritische Infrastruktur, Bildung)? → Ja: Die Frist verschiebt sich voraussichtlich auf Dezember 2027, ist aber noch nicht rechtskräftig. Beginnen Sie mit der Grundlagenarbeit: KI-Inventar, Risikobewertung, Governance-Strukturen.

Frage 4: Haben Sie die KI-Kompetenz-Anforderungen nach Artikel 4 bereits umgesetzt? → Nein: Diese Pflicht gilt seit Februar 2025. Handeln Sie sofort.

Frage 5: Setzen Sie KI nur für interne, nicht sicherheitsrelevante Zwecke ein (z. B. Textverarbeitung, interne Recherche)? → Dann greifen primär die KI-Kompetenz-Pflicht und ggf. Transparenzpflichten. Die Hochrisiko-Anforderungen sind wahrscheinlich nicht relevant. Trotzdem: Dokumentieren Sie Ihre Einschätzung nachvollziehbar.

Warum ist das wichtig? Dieser Entscheidungsbaum verhindert zwei gleichermaßen schädliche Reaktionen: überstürztes Handeln bei Systemen, die von der Verschiebung profitieren, und gefährliches Abwarten bei Pflichten, die bereits gelten oder unverändert am 2. August 2026 greifen.

Was als Nächstes? Dokumentieren Sie die Ergebnisse dieses Entscheidungsbaums für jedes KI-System in Ihrem KI-Register. Das schafft Nachvollziehbarkeit und ist die Grundlage für jede Konformitätsbewertung.

3 Schritte, wie Unternehmen sofort reagieren sollten

Schritt 1: KI-Inventar erstellen und Risikoklassen zuordnen

Erfassen Sie alle KI-Systeme in Ihrem Unternehmen – eingekaufte, selbst entwickelte und in Produkte eingebettete. Ordnen Sie jedem System eine vorläufige Risikoklasse zu (verboten, Hochrisiko, begrenztes Risiko, Minimalrisiko). Dokumentieren Sie für jedes System die Rolle Ihres Unternehmens (Anbieter, Betreiber oder beides). Ohne dieses Inventar ist keine fundierte Compliance-Planung möglich.

Zeitaufwand: Je nach Unternehmensgröße 2–6 Wochen. Je früher begonnen, desto besser – viele Unternehmen unterschätzen, wie viele KI-Systeme tatsächlich im Einsatz sind.

Schritt 2: Transparenzpflichten und KI-Kompetenz priorisieren

Diese beiden Anforderungen gelten unabhängig vom Digital Omnibus. Prüfen Sie, ob alle KI-gestützten Interaktionssysteme (Chatbots, virtuelle Assistenten) als solche erkennbar sind. Prüfen Sie, ob generative KI-Inhalte korrekt gekennzeichnet werden. Stellen Sie sicher, dass Mitarbeitende, die KI-Systeme einsetzen, über ausreichende KI-Kompetenz verfügen – und dokumentieren Sie dies.

Zeitaufwand: Transparenzprüfung 1–2 Wochen. KI-Kompetenz-Schulung lässt sich flexibel umsetzen, z. B. über eine AI Act Schulung mit Zertifikat.

Schritt 3: Governance-Strukturen und Verantwortlichkeiten festlegen

Bestimmen Sie, wer in Ihrem Unternehmen für KI-Compliance verantwortlich ist. Definieren Sie Prozesse für Risikobewertung, Freigabe neuer KI-Systeme und Vorfallmeldung. Nutzen Sie die gewonnene Zeit durch die voraussichtliche Fristverlängerung, um ein belastbares KI-Governance-Framework aufzubauen – idealerweise angelehnt an ISO 42001. So sind Sie vorbereitet, sobald die Hochrisiko-Pflichten greifen, und vermeiden hektische Nacharbeit.

Zeitaufwand: Governance-Grundstruktur 4–8 Wochen. Certurio bietet dafür Blueprints für KI-Governance und Risikomanagement, die den Aufbau beschleunigen.

FAQ

Ist der Digital Omnibus bereits beschlossen?

Nein. Stand 18. März 2026 hat der EU-Rat seine Verhandlungsposition festgelegt und das Europäische Parlament stimmt über seinen Bericht ab. Danach folgen die Trilog-Verhandlungen. Die formale Verabschiedung wird frühestens im zweiten Halbjahr 2026 erwartet. Bis dahin gelten die bestehenden Fristen des AI Act unverändert.

Welche Fristen bleiben vom Digital Omnibus unberührt?

Die verbotenen KI-Praktiken (seit Februar 2025 in Kraft), die KI-Kompetenz-Pflicht nach Artikel 4 (seit Februar 2025), die GPAI-Pflichten (seit August 2025) und die Transparenzpflichten nach Artikel 50 (ab August 2026). Diese Anforderungen werden durch den Digital Omnibus nicht verschoben.

Was passiert, wenn der Digital Omnibus scheitert oder sich stark verzögert?

Dann bleiben die ursprünglichen Fristen bestehen. Das bedeutet: Die vollständigen Hochrisiko-Anforderungen gelten ab dem 2. August 2026 für Annex-III-Systeme und ab dem 2. August 2027 für in Produkte eingebettete Systeme. Unternehmen, die ihre Compliance-Arbeit ausgesetzt haben, stünden dann ohne ausreichende Vorbereitung da.

Betrifft der Digital Omnibus auch KMU?

Ja, sogar in besonderer Weise. Der Vorschlag sieht erweiterte Erleichterungen für KMU und kleine Midcap-Unternehmen vor, darunter reduzierte Anforderungen bei Konformitätsbewertungen und regulatorische Sandboxen. Gleichzeitig gelten die Grundpflichten – KI-Kompetenz, Transparenz, Verbot bestimmter Praktiken – für alle Unternehmensgrößen.

Müssen Unternehmen außerhalb der EU den Digital Omnibus beachten?

Ja, wenn sie KI-Systeme in der EU auf den Markt bringen oder KI-Systeme einsetzen, deren Ergebnisse in der EU genutzt werden. Der AI Act hat extraterritoriale Wirkung. Der Digital Omnibus ändert daran nichts – er passt nur die Umsetzungsfristen an.

Einen umfassenden FAQ Bereich rund um den EU AI Act finden Sie hier.

Starten Sie Ihre KI-Compliance jetzt – nicht erst nach dem Omnibus

Die Fristverlängerung für Hochrisiko-KI durch den Digital Omnibus ist eine Chance, keine Pause. Unternehmen, die jetzt systematisch Governance-Strukturen aufbauen, ein KI-Inventar erstellen und ihre Mitarbeitenden schulen, sind im Vorteil – unabhängig davon, wann der Omnibus final verabschiedet wird.

Die EU AI Act Schulung von Certurio liefert Ihnen die Grundlagen und die Werkzeuge dafür: von der Risikoklassifizierung über Blueprints für KI-Governance und Risikomanagement bis hin zu auditfähigen Vorlagen für die technische Dokumentation. TÜV-zertifiziert, Harvard-basiert, praxisnah.

Weiterführende Links

Autor- und Transparenzhinweis

Dieser Artikel wurde von Certurio erstellt und basiert auf öffentlich zugänglichen, offiziellen Quellen: der Ratsposition vom 13. März 2026 (Consilium), dem Kommissionsvorschlag vom 19. November 2025 (Digital Omnibus on AI), dem Verordnungstext der KI-Verordnung (EU) 2024/1689 sowie dem zweiten Entwurf des Code of Practice zu Artikel 50 vom 3. März 2026.

Certurio ist Anbieter von KI-Compliance-Schulungen und -Materialien. Dieser Artikel stellt keine Rechtsberatung dar. Bei konkreten Compliance-Fragen sollten Sie qualifizierten Rechtsrat einholen.

Certurio ist Anbieter von KI-Compliance-Schulungen und -Materialien. Dieser Artikel stellt keine Rechtsberatung dar. Bei konkreten Compliance-Fragen sollten Sie qualifizierten Rechtsrat einholen.

EU AI Act Fakten

Schulungspflicht (nach Art. 4 EU AI Act)

- Gültigkeit: Ab August 2025

- Jeder Mitarbeiter, der KI im Arbeitskontext nutzt, muss hinsichtlich KI-Compliance geschult werden.

- Gültigkeit: Ab August 2025

- Jeder Mitarbeiter, der KI im Arbeitskontext nutzt, muss hinsichtlich KI-Compliance geschult werden.

Bußgeldrisiko (nach Art. 99 EU AI Act)

- Gültigkeit: Ab August 2026

- Fehlverhalten wird künftig mit bis zu 35 Millionen Euro Strafe oder 7% des Jahresumsatzes geahndet

- Gültigkeit: Ab August 2026

- Fehlverhalten wird künftig mit bis zu 35 Millionen Euro Strafe oder 7% des Jahresumsatzes geahndet