Mar 23

/

David Gall

Artikel 50 AI Act: Was Unternehmen jetzt über die Kennzeichnung KI-generierter Inhalte wissen müssen

Key Takeaways

- Artikel 50 des EU AI Act verpflichtet Anbieter und Betreiber von KI-Systemen, bestimmte KI-generierte Inhalte transparent zu kennzeichnen. Die Frist ist der 2. August 2026.

- Die Transparenzpflichten gelten für alle generativen KI-Systeme – unabhängig von der Risikoklasse. Ein Chatbot ist ebenso betroffen wie ein Hochrisiko-System.

- Der Digital Omnibus verschiebt die Hochrisiko-Fristen, aber nicht die Artikel-50-Pflichten. Diese bleiben unverändert bestehen.

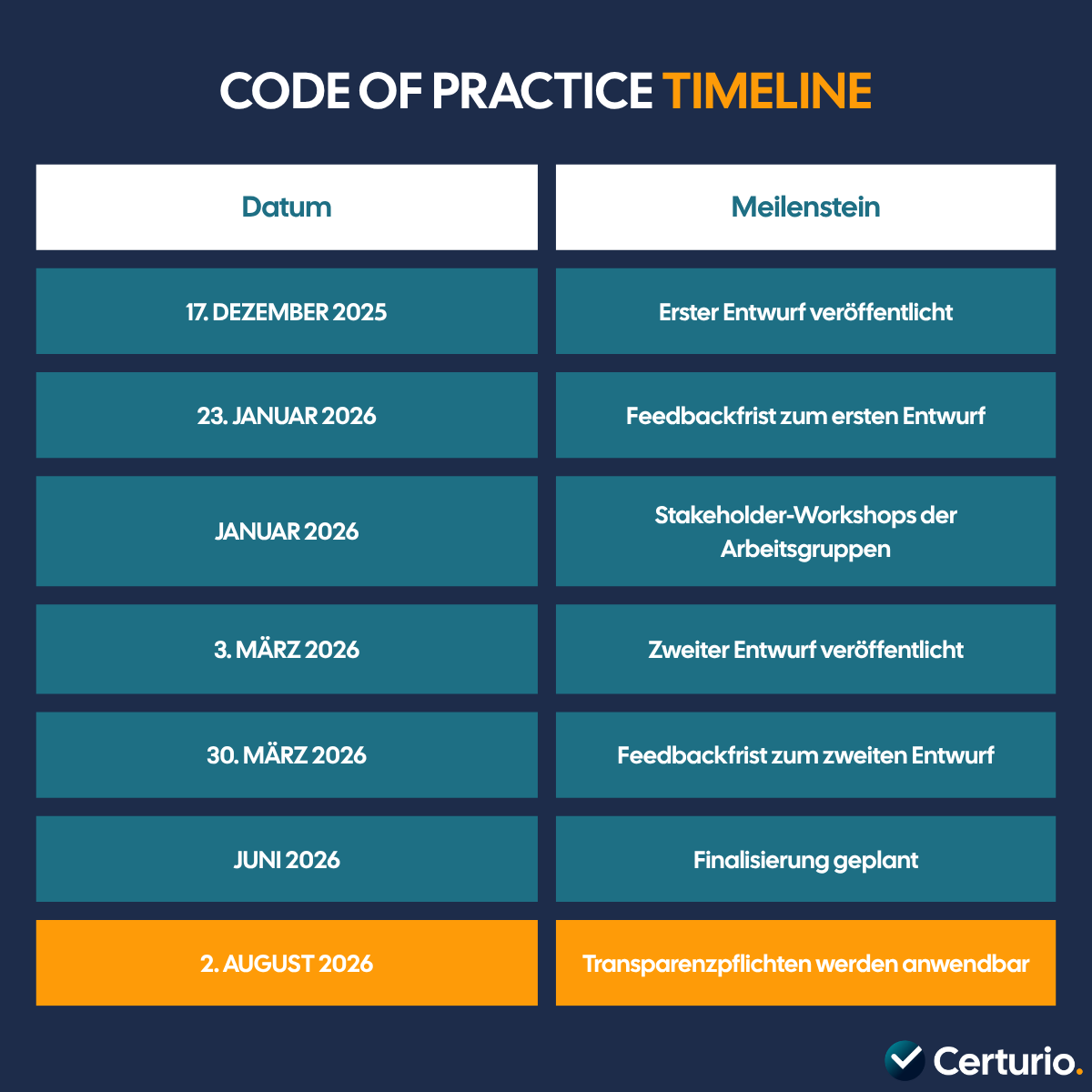

- Der zweite Entwurf des Code of Practice zur Kennzeichnung KI-generierter Inhalte wurde am 3. März 2026 veröffentlicht. Die Finalisierung ist bis Juni 2026 geplant.

- Vier Pflichtenkreise sind zu unterscheiden: Chatbot-Hinweispflicht, technische Markierung synthetischer Inhalte, Deepfake-Offenlegung und Kennzeichnung KI-generierter Texte von öffentlichem Interesse.

- Verstöße können mit Bußgeldern bis zu 15 Millionen Euro oder 3 % des weltweiten Jahresumsatzes geahndet werden.

Inhaltsverzeichnis

- Kurze Antwort: Was verlangt Artikel 50?

- Die vier Transparenzpflichten im Detail

- Anbieter vs. Betreiber: Wer muss was tun?

- Code of Practice: Der zweite Entwurf und was er konkret vorsieht

- Praxisbeispiele: Wann greift die Kennzeichnungspflicht – und wann nicht?

- Typische Fehler bei der Umsetzung – und wie Sie sie vermeiden

- Entscheidungsbaum: Muss Ihr KI-Inhalt gekennzeichnet werden?

- 3 Schritte, wie Unternehmen sofort reagieren sollten

- FAQ

- Autor- und Transparenzhinweis

Kurze Antwort: Was verlangt Artikel 50?

Artikel 50 der KI-Verordnung (EU) 2024/1689 regelt die Transparenz- und Kennzeichnungspflichten für KI-Systeme, die mit Menschen interagieren oder synthetische Inhalte erzeugen. Sein Anwendungsbereich ist breiter als der vieler anderer AI-Act-Vorschriften: Er betrifft nicht nur Hochrisiko-Systeme, sondern alle generativen KI-Systeme – von Chatbots über Bildgeneratoren bis hin zu Sprachsynthese-Tools.

Die Pflichten treten am 2. August 2026 vollständig in Kraft. Der aktuell diskutierte Digital Omnibus ändert daran nichts: Die vorgeschlagenen Fristverlängerungen betreffen ausschließlich Hochrisiko-KI-Systeme, nicht die Transparenzvorschriften nach Artikel 50. Jedes Unternehmen, das generative KI einsetzt oder anbietet, muss sich bis August 2026 vorbereiten. Der freiwillige Code of Practice, dessen zweiter Entwurf am 3. März 2026 veröffentlicht wurde, wird voraussichtlich als Maßstab dienen, an dem Aufsichtsbehörden die Einhaltung der Pflichten messen.

Die vier Transparenzpflichten im Detail

Artikel 50 unterscheidet vier verschiedene Pflichtenkreise, die sich an unterschiedliche Akteure richten und verschiedene Arten von KI-Systemen betreffen.

Pflicht 1: Hinweis bei direkter Interaktion mit KI – Art. 50 Abs. 1

Wer ist betroffen? Anbieter von KI-Systemen, die für die direkte Interaktion mit natürlichen Personen bestimmt sind.

Was ist zu tun? Das KI-System muss so konzipiert sein, dass Personen erkennen können, dass sie mit einem KI-System interagieren – und nicht mit einem Menschen.

Typischer Anwendungsfall: Chatbots, virtuelle Assistenten, KI-gestützte Kundenservice-Systeme.

Typischer Anwendungsfall: Chatbots, virtuelle Assistenten, KI-gestützte Kundenservice-Systeme.

Ausnahme: Die Pflicht entfällt, wenn die Interaktion mit einem KI-System aus Sicht einer aufmerksamen und verständigen Person aufgrund der Umstände und des Nutzungskontexts offensichtlich ist.

Beispiel: Sprachassistenten wie Siri oder Alexa, die durch ihre Bauform und Nutzungsweise eindeutig als KI erkennbar sind.

Beispiel: Sprachassistenten wie Siri oder Alexa, die durch ihre Bauform und Nutzungsweise eindeutig als KI erkennbar sind.

Sanktionen bei Verstößen: Bußgelder bis zu 15 Millionen Euro oder 3 % des weltweiten Jahresumsatzes

Pflicht 2: Technische Markierung synthetischer Inhalte – Art. 50 Abs. 2

Wer ist betroffen? Anbieter von KI-Systemen, die synthetische Audio-, Bild-, Video- oder Textinhalte erzeugen.

Was ist zu tun? Die Ergebnisse des KI-Systems müssen in einem maschinenlesbaren Format als künstlich erzeugt oder manipuliert gekennzeichnet werden. Die Markierung muss erkennbar und interoperabel sein. Konkret bedeutet das: Metadaten, Wasserzeichen oder vergleichbare technische Verfahren, die auch nach Bearbeitung der Inhalte noch nachweisbar bleiben.

Ausnahme: KI-Systeme, die lediglich eine unterstützende Funktion bei der Standardbearbeitung ausführen oder die Eingabedaten nicht wesentlich verändern – etwa ein KI-Rechtschreibtool oder ein kleinflächiges „Generative Fill" in Bildbearbeitungssoftware.

Wichtig: Diese Pflicht richtet sich an die Anbieter der KI-Systeme (z. B. OpenAI, Midjourney, Adobe), nicht an die Unternehmen, die diese Tools nutzen. Betreiber profitieren aber davon, weil die technische Markierung ihnen die eigene Kennzeichnungsarbeit erleichtert.

Pflicht 3: Offenlegung von Deepfakes – Art. 50 Abs. 4, Satz 1–3

Wer ist betroffen? Betreiber von KI-Systemen, die Bild-, Ton- oder Videoinhalte erzeugen oder manipulieren, die als Deepfake einzustufen sind.

Was ist ein Deepfake im Sinne des AI Act? Ein durch KI erzeugter oder manipulierter Bild-, Ton- oder Videoinhalt, der wirklichen Personen, Gegenständen, Orten, Einrichtungen oder Ereignissen ähnelt und einer Person fälschlicherweise als echt oder wahrheitsgemäß erscheinen könnte (Art. 3 Nr. 60 KI-VO).

Was ist zu tun? Betreiber müssen offenlegen, dass der Inhalt künstlich erzeugt oder manipuliert wurde. Die Offenlegung muss klar, eindeutig und spätestens bei der ersten Wahrnehmung des Inhalts erfolgen.

Ausnahmen:

- Strafverfolgung: Die Pflicht entfällt, wenn die Verwendung zur Aufdeckung, Verhütung oder Verfolgung von Straftaten gesetzlich zugelassen ist.

- Künstlerische Werke: Bei offensichtlich künstlerischen, kreativen, satirischen oder fiktionalen Inhalten beschränkt sich die Pflicht auf eine angemessene Offenlegung, die den Genuss des Werks nicht beeinträchtigt.

Pflicht 4: Kennzeichnung KI-generierter Texte von öffentlichem Interesse – Art. 50 Abs. 4, Satz 4

Wer ist betroffen? Betreiber von KI-Systemen, die Text erzeugen oder manipulieren, der veröffentlicht wird, um die Öffentlichkeit über Angelegenheiten von öffentlichem Interesse zu informieren.

Was ist zu tun? Die Tatsache, dass der Text künstlich erzeugt oder manipuliert wurde, muss offengelegt werden.

Ausnahme: Die Kennzeichnungspflicht entfällt, wenn der Text einer menschlichen Überprüfung oder redaktionellen Kontrolle unterliegt und eine natürliche oder juristische Person die redaktionelle Verantwortung für die Veröffentlichung trägt. Dies betrifft typischerweise Medienunternehmen mit redaktioneller Kontrolle.

Wichtige Abgrenzung: Klassische Marketingtexte, Website-Texte und Werbeanzeigen fallen in der Regel nicht unter diese Pflicht, sofern sie nicht den Zweck verfolgen, die Öffentlichkeit über Angelegenheiten von öffentlichem Interesse zu informieren. Allerdings ist die Grenze nicht immer trennscharf – Unternehmensblogbeiträge zu gesellschaftlichen Themen, Pressemitteilungen oder Stellungnahmen zu politischen Fragen können durchaus betroffen sein.

Warum ist das wichtig? Artikel 50 ist die AI-Act-Vorschrift mit der größten Breitenwirkung. Während die Hochrisiko-Pflichten nur bestimmte Branchen und Anwendungsfälle betreffen, erfasst Artikel 50 praktisch jedes Unternehmen, das generative KI einsetzt – vom Einzelhandelsunternehmen mit Chatbot bis zum Konzern mit KI-gestützter Content-Produktion. Die Frist August 2026 gilt ohne Einschränkung. Wer sie verpasst, riskiert Sanktionen und Vertrauensverlust.

Was als Nächstes? Verschaffen Sie sich einen vollständigen Überblick über alle generativen KI-Systeme in Ihrem Unternehmen. Ein KI-Register und eine systematische Inventarisierung sind die Grundlage für jede Artikel-50-Compliance.

Anbieter vs. Betreiber: Wer muss was tun?

Die Pflichten aus Artikel 50 verteilen sich unterschiedlich auf Anbieter (Provider) und Betreiber (Deployer). Die Unterscheidung ist entscheidend, weil sie bestimmt, welche konkreten Maßnahmen ein Unternehmen ergreifen muss.

Pflichten der Anbieter

Anbieter sind Unternehmen, die KI-Systeme entwickeln oder unter eigenem Namen auf den Markt bringen. Ihre Pflichten nach Artikel 50:

Art. 50 Abs. 1 – Interaktionssysteme: Das System muss so gestaltet sein, dass Nutzer erkennen, dass sie mit KI interagieren. Dies ist eine Designpflicht, die in die Systemarchitektur integriert werden muss.

Art. 50 Abs. 2 – Synthetische Inhalte: KI-generierte Audio-, Bild-, Video- und Textinhalte müssen maschinenlesbar als KI-erzeugt markiert werden. Der Code of Practice sieht dafür einen zweistufigen Ansatz vor: gesicherte Metadaten und Wasserzeichen. Optional ergänzt durch Fingerprinting und Logging.

Pflichten der Betreiber

Betreiber sind Unternehmen, die KI-Systeme in eigener Verantwortung einsetzen – etwa für Marketing, Kundenservice, Produktkommunikation oder interne Prozesse. Die meisten Unternehmen, die Tools wie ChatGPT, Microsoft Copilot, Midjourney oder DALL-E nutzen, sind Betreiber.

Art. 50 Abs. 3 – Emotionserkennung und biometrische Kategorisierung: Betreiber müssen betroffene Personen informieren, wenn ein solches System im Einsatz ist.

Art. 50 Abs. 4 – Deepfakes und KI-Texte: Betreiber müssen Deepfakes als KI-erzeugt offenlegen und KI-generierte Texte zu Themen von öffentlichem Interesse kennzeichnen.

Doppelrolle beachten

Viele Unternehmen sind für verschiedene Systeme gleichzeitig Anbieter und Betreiber. Beispiel: Ein Softwareunternehmen entwickelt einen KI-gestützten Chatbot für seine Kunden (Anbieter) und nutzt intern Midjourney für Marketingbilder (Betreiber). Beide Rollenprofile erfordern unterschiedliche Maßnahmen. Ohne eine klare Rollenzuordnung pro System ist eine saubere Compliance nicht möglich.

Checkliste: Rollenklärung

Für jedes KI-System im Unternehmen klären:

- Haben wir das System selbst entwickelt oder unter eigenem Namen in Betrieb genommen? → Anbieter-Pflichten prüfen

- Setzen wir ein Drittanbieter-Tool ein (z. B. ChatGPT, Copilot, Midjourney)? → Betreiber-Pflichten prüfen

- Bieten wir ein auf Drittanbieter-KI aufbauendes Produkt unter eigenem Namen an? → Möglicherweise beide Rollen

Warum ist das wichtig? Die Pflichtenzuordnung scheitert in der Praxis häufig an einer fehlenden Rollenklärung. Unternehmen wissen oft nicht, ob sie für ein bestimmtes KI-System als Anbieter oder Betreiber gelten – und welche Transparenzmaßnahmen daraus folgen. Ohne diese Zuordnung ist eine gezielte Compliance-Planung unmöglich, und bei einer Prüfung durch die Aufsichtsbehörde fehlt die Grundlage für den Nachweis.

Was als Nächstes? Dokumentieren Sie die Rollenverteilung für jedes KI-System in Ihrem Unternehmen. Die EU AI Act Schulung von Certurio enthält eine detaillierte Anleitung zur Rollenbestimmung nach AI Act und Vorlagen für die Dokumentation.

Code of Practice: Der zweite Entwurf und was er konkret vorsieht

Was ist der Code of Practice?

Der Code of Practice zur Transparenz KI-generierter Inhalte ist ein freiwilliger Verhaltenskodex, den das EU AI Office gemeinsam mit unabhängigen Experten entwickelt. Er konkretisiert die Pflichten aus Artikel 50 und soll Anbietern und Betreibern als praktische Orientierung dienen. Obwohl der Code rechtlich unverbindlich ist, wird er voraussichtlich als zentraler Maßstab fungieren, an dem Aufsichtsbehörden und Gerichte die Einhaltung der gesetzlichen Anforderungen messen.

Timeline des Code of Practice

Was hat sich im zweiten Entwurf geändert?

Der zweite Entwurf ist gegenüber der ersten Fassung deutlich schlanker, flexibler und praxisorientierter.

Die wichtigsten Änderungen:

Die wichtigsten Änderungen:

Taxonomie entfällt: Der erste Entwurf unterschied zwischen „KI-generiert" und „KI-unterstützt" und verlangte eine entsprechende differenzierte Kennzeichnung. Diese Taxonomie wurde im zweiten Entwurf vollständig gestrichen. Damit entfallen aufwändige Grenzfall-Diskussionen im Unternehmen darüber, ob ein Inhalt „noch unterstützt" oder „schon generiert" ist.

Zweistufiger Markierungsansatz: Für Anbieter sieht der Code einen überarbeiteten Ansatz vor: gesicherte Metadaten (z. B. C2PA, IPTC) und Wasserzeichen als Kernanforderungen. Fingerprinting und Logging sind optional.

Offene Standards: Der Entwurf fördert ausdrücklich die Verwendung offener, herstellerneutraler Standards für die KI-Inhaltsmarkierung, um Interoperabilität zu gewährleisten und Kosten zu senken.

EU-Icon: Der Kodex schlägt ein EU-weit einheitliches Symbol zur Kennzeichnung KI-generierter Inhalte vor. Als Übergangslösung bis zur Fertigstellung eines interaktiven EU-Icons wird ein visuelles Label mit der Abkürzung „KI" (bzw. „AI" auf Englisch) empfohlen. Im Anhang des zweiten Entwurfs finden sich illustrative Beispiele für das geplante Icon.

Flexiblere Deployer-Pflichten: Für Betreiber enthält der zweite Entwurf praxisnähere Gestaltungs- und Platzierungsanforderungen für Icons, Labels und Disclaimer. Statt starrer Vorgaben können Betreiber Lösungen entwickeln, die auf ihren konkreten Anwendungsfall zugeschnitten sind – solange ein Mindestmaß an Einheitlichkeit und Erkennbarkeit gewährleistet ist.

Klarere Ausnahmen: Die Regeln für künstlerische, kreative, satirische und fiktionale Werke sowie für Texte unter redaktioneller Verantwortung wurden präzisiert.

Warum ist das wichtig? Der Code of Practice wird zum de-facto-Standard für die praktische Umsetzung der Artikel-50-Pflichten. Auch wenn er formell freiwillig bleibt, werden Aufsichtsbehörden ihn als Referenz heranziehen. Unternehmen, die sich nicht am Code orientieren, müssen bei Kontrollen erklären, wie sie die gesetzlichen Anforderungen auf anderem Weg erfüllen. Wer den Code kennt und seine Compliance daran ausrichtet, reduziert das Prüfungsrisiko erheblich.

Was als Nächstes? Lesen Sie den zweiten Entwurf und prüfen Sie, welche Maßnahmen auf Ihr Unternehmen zukommen. Die Feedbackfrist läuft bis 30. März 2026. Eine strukturierte KI-Compliance-Schulung hilft, die Anforderungen systematisch einzuordnen.

Praxisbeispiele: Wann greift die Kennzeichnungspflicht – und wann nicht?

Beispiel 1: E-Commerce-Unternehmen mit Chatbot und KI-Produktbildern

Ein Online-Händler setzt einen KI-gestützten Chatbot im Kundenservice ein und lässt Produktbilder mit einem KI-Bildgenerator erstellen.

Chatbot: Der Chatbot fällt unter Art. 50 Abs. 1. Kunden müssen erkennen können, dass sie mit einem KI-System kommunizieren. In der Praxis bedeutet das: Eine deutliche Kennzeichnung im Chat-Interface, z. B. „Sie kommunizieren mit einem KI-Assistenten." Der Hinweis muss klar, eindeutig und vor oder spätestens bei Beginn der Interaktion erfolgen.

Produktbilder: Wenn die KI-generierten Bilder reale Produkte darstellen und so realistisch sind, dass sie als Fotografien wahrgenommen werden könnten, können sie als Deepfake im Sinne des AI Act gelten – insbesondere wenn sie realen Gegenständen oder Szenen ähneln. Die Abgrenzung ist im Einzelfall zu prüfen. Rein dekorative, offensichtlich stilisierte Grafiken sind in der Regel nicht betroffen.

Produktbeschreibungen: KI-generierte Produkttexte auf der Website fallen typischerweise nicht unter die Kennzeichnungspflicht nach Art. 50 Abs. 4, da sie keine Informationen zu Angelegenheiten von öffentlichem Interesse darstellen. Dennoch kann eine freiwillige Kennzeichnung Vertrauen stärken.

Beispiel 2: Unternehmensberatung mit KI-generierter Thought-Leadership-Kommunikation

Eine Beratungsgesellschaft nutzt generative KI, um Blogbeiträge, Whitepapers und LinkedIn-Beiträge zu regulatorischen Themen zu erstellen.

Blogbeiträge zu regulatorischen Entwicklungen: Wenn ein KI-generierter Blogbeitrag die Öffentlichkeit über Angelegenheiten von öffentlichem Interesse informiert – etwa über neue Gesetzgebung, Wirtschaftspolitik oder regulatorische Änderungen – greift Art. 50 Abs. 4. Die Pflicht entfällt jedoch, wenn eine Person die redaktionelle Verantwortung trägt und den Text vor Veröffentlichung inhaltlich überprüft und freigibt. In der Praxis heißt das: Ein klarer Redaktionsworkflow (KI-Entwurf → fachliche Prüfung → inhaltliche Freigabe → Veröffentlichung) kann die Kennzeichnungspflicht entfallen lassen, sofern die redaktionelle Kontrolle dokumentiert ist.

Interne Verwendung: KI-generierte interne Dokumente, Präsentationen oder Notizen, die nicht veröffentlicht werden, fallen nicht unter Artikel 50.

Beispiel 3: Marketingagentur mit KI-generierten Video- und Audio-Inhalten

Eine Agentur produziert für ihre Kunden Werbeclips mit KI-generierten Sprecherstimmen und Avatar-Videos.

Synthetische Stimmen und Avatar-Videos: Wenn die erzeugten Inhalte realen Personen ähneln und als echt wahrgenommen werden könnten, handelt es sich um Deepfakes im Sinne von Art. 3 Nr. 60 KI-VO. Die Betreiberpflicht nach Art. 50 Abs. 4 greift: Die Agentur bzw. der Auftraggeber muss offenlegen, dass die Inhalte künstlich erzeugt wurden. Der Hinweis sollte direkt im oder am Inhalt platziert werden – nicht versteckt in den AGB oder am Ende einer Website.

Offensichtlich fiktionale Werbung: Wenn der KI-generierte Clip offensichtlich künstlerischen oder fiktionalen Charakter hat – etwa ein animiertes Maskottchen – beschränkt sich die Pflicht auf eine angemessene Offenlegung, die den Genuss des Werks nicht beeinträchtigt.

Warum ist das wichtig? Die Praxisbeispiele zeigen, dass die Grenzziehung nicht immer einfach ist. Entscheidend ist eine zentrale Prüffrage: „Kann der durchschnittliche Nutzer durch den KI-Output getäuscht werden?" Wenn ja, besteht in der Regel eine Kennzeichnungspflicht. Unternehmen, die sich diese Frage für jeden Anwendungsfall systematisch stellen, vermeiden Fehleinschätzungen.

Was als Nächstes? Etablieren Sie einen internen Prüfprozess für KI-generierte Inhalte. Die Certurio-Schulung enthält Vorlagen und Blueprints für KI-Governance, die einen solchen Prozess strukturieren.

Typische Fehler bei der Umsetzung – und wie Sie sie vermeiden

Fehler 1: „Uns betrifft das nicht – wir sind kein Hochrisiko-Unternehmen"

Artikel 50 gilt unabhängig von der Risikoklassifizierung. Jedes Unternehmen, das einen Chatbot betreibt, KI-Bilder veröffentlicht oder KI-generierte Texte zu Themen von öffentlichem Interesse publiziert, ist betroffen. Die Hochrisiko-Einstufung ist für Artikel 50 irrelevant.

Fehler 2: Kennzeichnung nur als Fußnote oder in den AGB

Artikel 50 Abs. 5 verlangt, dass die Informationen klar, eindeutig und barrierefrei bereitgestellt werden – spätestens bei der ersten Interaktion oder Wahrnehmung des Inhalts. Eine Kennzeichnung, die im Kleingedruckten versteckt ist, erfüllt die Anforderungen nicht. Der Code of Practice empfiehlt sichtbare Labels direkt am Inhalt.

Fehler 3: Auf den KI-Anbieter verlassen und selbst nichts tun

Die technische Markierung (Metadaten, Wasserzeichen) ist Pflicht der Anbieter. Aber die sichtbare Offenlegung bei Deepfakes und die Kennzeichnung bei KI-Texten ist Betreiberpflicht. Beide Ebenen müssen unabhängig voneinander erfüllt sein. Wer darauf vertraut, dass der Anbieter „schon alles regelt", handelt nicht compliant.

Fehler 4: Keinen Redaktionsworkflow für KI-generierte Inhalte

Die Ausnahme von der Textkennzeichnungspflicht greift nur, wenn redaktionelle Kontrolle nachweisbar ist. „Wir schauen immer noch mal drüber" reicht als Nachweis nicht aus. Unternehmen brauchen einen dokumentierten Prozess: KI-Entwurf → fachliche Prüfung → Freigabe durch benannte verantwortliche Person. Ohne Dokumentation gibt es keinen Nachweis – und ohne Nachweis greift die Ausnahme bei einer Prüfung nicht.

Fehler 5: Artikel-50-Pflichten mit den verschobenen Hochrisiko-Fristen verwechseln Der Digital Omnibus verschiebt die Fristen für Hochrisiko-KI-Systeme, nicht die Transparenzpflichten. Diese Verwechslung ist aktuell eines der größten Risiken: Unternehmen, die fälschlicherweise annehmen, alle AI-Act-Fristen seien verschoben, stehen am 2. August 2026 ohne Vorbereitung da.

Do's & Don'ts

Do:

- Chatbot-Hinweis direkt im Interface platzieren, nicht auf einer separaten Seite

- KI-generierte Bilder und Videos mit sichtbarem Label versehen, wenn sie als echt wahrgenommen werden könnten

- Redaktionsworkflow für KI-Texte dokumentieren, nicht nur praktizieren

- Code of Practice als Referenz für die eigene Umsetzung nutzen

- Alle KI-Systeme mit Inhaltsproduktion im KI-Register erfassen

Don't:

- Darauf vertrauen, dass der Anbieter die gesamte Kennzeichnung übernimmt

- Kennzeichnung in AGB oder Datenschutzerklärung verstecken

- Annehmen, dass interne Nutzung automatisch von Artikel 50 befreit ist (stimmt nur, wenn die Inhalte nicht veröffentlicht werden)

- Die Artikel-50-Fristen mit den Hochrisiko-Fristen des Digital Omnibus verwechseln

- Sich darauf verlassen, dass die Aufsichtsbehörden noch nicht kontrollieren

Warum ist das wichtig? Jeder dieser Fehler kann unmittelbare Rechtsfolgen haben: Bußgelder bis zu 15 Millionen Euro oder 3 % des Jahresumsatzes, behördliche Anordnungen oder Reputationsschäden. Die Transparenzpflichten sind dabei vergleichsweise einfach umzusetzen – wenn sie rechtzeitig adressiert werden. Nachträgliche Korrekturen sind aufwändiger und teurer als eine frühzeitige Implementierung.

Was als Nächstes? Prüfen Sie, ob Ihre bestehenden Veröffentlichungsprozesse die Anforderungen von Artikel 50 bereits abdecken. Die Schnittstellen zwischen AI Act und DSGVO sollten dabei mitgedacht werden, insbesondere bei Emotionserkennungssystemen und biometrischer Kategorisierung.

Entscheidungsbaum: Muss Ihr KI-Inhalt gekennzeichnet werden?

Nutzen Sie diese Prüflogik für jeden KI-generierten Inhalt in Ihrem Unternehmen:

Frage 1: Interagiert eine Person direkt mit einem KI-System (z. B. Chatbot, virtueller Assistent)? → Ja: Hinweispflicht nach Art. 50 Abs. 1. Die Person muss erkennen können, dass sie mit KI kommuniziert. → Ausnahme: Die KI-Eigenschaft ist offensichtlich (z. B. Siri, Alexa).

Frage 2: Erzeugt das KI-System synthetische Inhalte (Text, Bild, Audio, Video)? → Ja, und Sie sind Anbieter des Systems: Technische Markierung nach Art. 50 Abs. 2 erforderlich (maschinenlesbar). → Ja, und Sie sind Betreiber: Prüfen Sie Fragen 3 und 4.

Frage 3: Handelt es sich bei dem erzeugten Bild-, Audio- oder Videoinhalt um einen Deepfake? → Prüffrage: Ähnelt der Inhalt realen Personen, Gegenständen, Orten oder Ereignissen und könnte als echt wahrgenommen werden? → Ja: Offenlegungspflicht nach Art. 50 Abs. 4. Sichtbare Kennzeichnung erforderlich. → Ausnahme: Offensichtlich künstlerische, kreative, satirische oder fiktionale Inhalte → reduzierte Offenlegung genügt.

Frage 4: Ist der erzeugte Text dazu bestimmt, die Öffentlichkeit über Angelegenheiten von öffentlichem Interesse zu informieren? → Ja: Kennzeichnungspflicht nach Art. 50 Abs. 4, Satz 4. → Ausnahme: Der Text unterliegt menschlicher Überprüfung und eine Person trägt die redaktionelle Verantwortung → Kennzeichnungspflicht entfällt. → Nein (reiner Marketingtext, Produktbeschreibung, interne Nutzung): Keine Kennzeichnungspflicht nach Art. 50.

Frage 5: Wird ein Emotionserkennungs- oder biometrisches Kategorisierungssystem eingesetzt? → Ja: Informationspflicht gegenüber betroffenen Personen nach Art. 50 Abs. 3.

Warum ist das wichtig? Dieser Entscheidungsbaum verhindert sowohl unnötige Kennzeichnung (die Ressourcen verschwendet und Nutzer irritiert) als auch fehlende Kennzeichnung (die Bußgelder und Vertrauensverlust auslöst). Die systematische Prüfung jedes Inhaltstyps schafft Rechtssicherheit.

Was als Nächstes? Integrieren Sie diese Prüflogik in Ihre bestehenden Freigabeprozesse für Inhalte. Weitere Hintergründe zu Risikoklassen und Anwendungsbereich finden Sie in der Übersicht der AI Act Risikoklassen.

3 Schritte, wie Unternehmen sofort reagieren sollten

Schritt 1: Mitarbeitende schulen und Verantwortlichkeiten festlegen

Artikel 50 kann nur eingehalten werden, wenn alle Mitarbeitenden, die KI-generierte Inhalte erstellen oder veröffentlichen, die Anforderungen kennen. Die Pflicht zur Förderung von KI-Kompetenz nach Artikel 4 AI Act gilt bereits seit Februar 2025 und umfasst auch das Wissen über Transparenzanforderungen.

Schulen Sie insbesondere: Marketing- und Kommunikationsabteilungen, Kundenservice-Teams, Content-Ersteller und Social-Media-Verantwortliche, IT- und Produktverantwortliche für KI-gestützte Systeme. Benennen Sie eine verantwortliche Person oder Stelle, die die Einhaltung der Transparenzpflichten überwacht und als Ansprechpartner für Zweifelsfälle dient.

Zeitaufwand: Schulung je nach Umfang 2-3 Stunden. Eine AI Act Schulung mit Zertifikat deckt sowohl Artikel 50 als auch die übergreifenden Compliance-Anforderungen ab.

Schritt 2: Alle generativen KI-Systeme erfassen und klassifizieren

Erstellen Sie eine vollständige Liste aller KI-Systeme in Ihrem Unternehmen, die Inhalte erzeugen oder mit Personen interagieren. Für jedes System dokumentieren Sie: Name und Anbieter, Art der erzeugten Inhalte (Text, Bild, Audio, Video), Einsatzbereich (Kundenservice, Marketing, interne Kommunikation, Produktentwicklung), Ihre Rolle (Anbieter oder Betreiber), ob die erzeugten Inhalte veröffentlicht werden.

Denken Sie dabei auch an Drittanbieter-Tools, die einzelne Mitarbeitende eigenständig nutzen – sogenannte Schatten-KI. Ohne vollständige Erfassung ist keine belastbare Compliance-Planung möglich.

Zeitaufwand: 1–3 Wochen, abhängig von der Unternehmensgröße und der Anzahl eingesetzter Tools.

Schritt 3: Kennzeichnungspflichten pro System bestimmen und Prozesse aufbauen

Wenden Sie den Entscheidungsbaum aus dem vorherigen Abschnitt auf jedes erfasste System an. Dokumentieren Sie für jedes System, ob und welche Kennzeichnungspflicht besteht. Bauen Sie die erforderlichen Maßnahmen in Ihre bestehenden Prozesse ein:

- Chatbots: KI-Hinweis im Interface implementieren

- KI-Bilder und -Videos: Label-/Wasserzeichen-Lösung evaluieren

- KI-Texte: Redaktionsworkflow dokumentieren (Entwurf → Prüfung → Freigabe → Veröffentlichung)

- Deepfakes: Offenlegungshinweis direkt am Inhalt platzieren

Erstellen Sie zudem eine interne KI-Richtlinie, die den Umgang mit generativer KI im Unternehmen regelt. Certurio bietet ein KI-Richtlinien-Muster, das Sie an Ihre Bedürfnisse anpassen können.

Zeitaufwand: 2–4 Wochen für die Pflichtenanalyse, 4–8 Wochen für die Prozessintegration.

FAQ

Gilt die Kennzeichnungspflicht auch für rein intern genutzte KI-Inhalte?

Nein. Artikel 50 erfasst Inhalte, die veröffentlicht oder gegenüber natürlichen Personen eingesetzt werden. Rein interne Dokumente, die nicht veröffentlicht werden und nicht in die direkte Interaktion mit Personen außerhalb des Unternehmens gelangen, unterliegen nicht den Transparenzpflichten. Allerdings sollte auch der interne KI-Einsatz dokumentiert werden – für die KI-Kompetenz-Pflicht nach Artikel 4 und für die allgemeine Governance-Nachweisführung.

Müssen Marketing-Texte, die mit ChatGPT erstellt wurden, gekennzeichnet werden?

In der Regel nicht, sofern es sich um klassische Werbetexte oder Produktbeschreibungen handelt, die nicht den Zweck verfolgen, die Öffentlichkeit über Angelegenheiten von öffentlichem Interesse zu informieren. Wird der Text zusätzlich von einer Person inhaltlich überprüft und freigegeben, entfällt die Kennzeichnungspflicht nach Art. 50 Abs. 4 ohnehin. Entscheidend ist: ein dokumentierter Redaktionsworkflow.

In der Regel nicht, sofern es sich um klassische Werbetexte oder Produktbeschreibungen handelt, die nicht den Zweck verfolgen, die Öffentlichkeit über Angelegenheiten von öffentlichem Interesse zu informieren. Wird der Text zusätzlich von einer Person inhaltlich überprüft und freigegeben, entfällt die Kennzeichnungspflicht nach Art. 50 Abs. 4 ohnehin. Entscheidend ist: ein dokumentierter Redaktionsworkflow.

Ist der Code of Practice rechtlich verbindlich?

Nein, der Code of Practice ist ein freiwilliger Verhaltenskodex. Er wird jedoch voraussichtlich als zentraler Referenzrahmen für Aufsichtsbehörden und Gerichte dienen, um zu bewerten, ob ein Unternehmen seine Transparenzpflichten angemessen erfüllt. Unternehmen, die dem Code nicht folgen, tragen eine höhere Begründungslast bei Prüfungen.

Nein, der Code of Practice ist ein freiwilliger Verhaltenskodex. Er wird jedoch voraussichtlich als zentraler Referenzrahmen für Aufsichtsbehörden und Gerichte dienen, um zu bewerten, ob ein Unternehmen seine Transparenzpflichten angemessen erfüllt. Unternehmen, die dem Code nicht folgen, tragen eine höhere Begründungslast bei Prüfungen.

Werden die Artikel-50-Fristen durch den Digital Omnibus verschoben?

Nein. Der Digital Omnibus sieht Fristverlängerungen ausschließlich für Hochrisiko-KI-Systeme vor. Die Transparenzpflichten nach Artikel 50 gelten unverändert ab dem 2. August 2026. Lediglich für synthetische Audio-, Bild- und Videoinhalte von Bestandssystemen, die vor August 2026 auf dem Markt waren, sieht der Ratsvorschlag eine verlängerte Übergangsfrist bis Februar 2027 vor.

Wie hoch sind die Bußgelder bei Verstößen gegen Artikel 50?

Verstöße gegen die Transparenzpflichten nach Artikel 50 können mit Geldbußen von bis zu 15 Millionen Euro oder 3 % des weltweiten Jahresumsatzes geahndet werden – je nachdem, welcher Betrag höher ist. Für KMU und Startups gelten abgestufte Sanktionsrahmen.

Bereiten Sie Ihr Unternehmen jetzt auf die Transparenzpflichten vor

Die Kennzeichnung KI-generierter Inhalte ist keine Option – sie wird ab August 2026 Pflicht. Die Anforderungen betreffen praktisch jedes Unternehmen, das generative KI einsetzt, unabhängig von der Branche oder Unternehmensgröße.

Die EU AI Act Schulung von Certurio vermittelt nicht nur die rechtlichen Grundlagen, sondern liefert konkrete Werkzeuge für die Umsetzung: Vorlagen für KI-Richtlinien, Blueprints für KI-Governance und Risikomanagement, Checklisten für Transparenz- und Kennzeichnungspflichten sowie praxisnahe Materialien für Audits. TÜV-zertifiziert, Harvard-basiert, direkt anwendbar.

Autor- und Transparenzhinweis

Dieser Artikel wurde von Certurio erstellt und basiert auf dem Verordnungstext der KI-Verordnung (EU) 2024/1689, dem zweiten Entwurf des Code of Practice on Marking and Labelling of AI-Generated Content (veröffentlicht am 3. März 2026 durch die Europäische Kommission), der Ratsposition zum Digital Omnibus vom 13. März 2026 sowie Analysen unabhängiger Kanzleien und Fachportale. Certurio ist Anbieter von KI-Compliance-Schulungen und -Materialien. Dieser Artikel stellt keine Rechtsberatung dar. Bei konkreten Compliance-Fragen sollten Sie qualifizierten Rechtsrat einholen.

EU AI Act Fakten

Schulungspflicht (nach Art. 4 EU AI Act)

- Gültigkeit: Ab August 2025

- Jeder Mitarbeiter, der KI im Arbeitskontext nutzt, muss hinsichtlich KI-Compliance geschult werden.

- Gültigkeit: Ab August 2025

- Jeder Mitarbeiter, der KI im Arbeitskontext nutzt, muss hinsichtlich KI-Compliance geschult werden.

Bußgeldrisiko (nach Art. 99 EU AI Act)

- Gültigkeit: Ab August 2026

- Fehlverhalten wird künftig mit bis zu 35 Millionen Euro Strafe oder 7% des Jahresumsatzes geahndet

- Gültigkeit: Ab August 2026

- Fehlverhalten wird künftig mit bis zu 35 Millionen Euro Strafe oder 7% des Jahresumsatzes geahndet